「人工智慧會取代人類的工作嗎?」「我們應該如何因應人工智慧的衝擊?」大概是這兩年生成式AI出現後,媒體最常見的熱門話題。仔細探究,從這類問題中隱然呈現出科技主動、人類只能被動因應的集體潛意識,但是,人工智慧不是人發明的嗎?為什麼會主客易位?

在《設計,讓世界變更好》一書中,作者 Donald A. Norman 從設計的角度切入,跨越歷史長河,為我們揭示了這個問題的根本原因,並提出具有建設性的解決方案:「我們世界中的許多事物,即使原本是自然的事物,其實都是人所造出來的。正因為它們是由人類創造的,因此我們能夠將它們改變成更理想的結果,保留好的部分,並且改變壞的影響──例如氣候變遷、戰爭和動植物物種的滅絕。」

年近 90 歲的 Donald A. Norman 在加州大學聖地牙哥分校開展了認知心理學這一門新興學科,並成立認知科學系。之後更將認知科學延伸到認知工程,是該領域的主要引導者。曾擔任蘋果公司副總裁、多家企業的顧問和董事會成員;人工智慧領域的教父 Geoffrey Hinton 也曾是他的博士後學生。

他在〈台灣版序〉中特別提出:「這本書需要一位知識淵博的翻譯者,來合理詳細地介紹書中所討論的許多不同主題,我真的很幸運,能夠由我的朋友 Yihsiu Chen 來翻譯這本書。」譯者陳宜秀任教於政治大學數位內容與科技學程,哥倫比亞大學社會心理學博士。曾任職於美國與台灣科技業逾二十年,從事互動設計和通訊產品的研發工作,累積三十餘項專利並獲多項國際設計大獎。

這本書拆解了現代社會中所存在的權力結構,包括我們慣常視之為「中性」的科技;並且挑戰讀者以批判性思維重新審視我們所習以為常的現有規範系統。更重要的是,他相信人類有可能改變自己所創造的一切,以「設計」為軸,可以調動各種系統來解決科技、政策、人類與自然之間的複雜現況。以下為本書部分精彩內容:

自人類誕生以來,我們一直在發展各種用於生活、飲食、衣著、居住與日常活動的科技,以及定義和規範治理、行為、數學、貨幣和法律形式。這種對於人造物(artifacts)的設計,使科技成為人類生活的基礎之一,以至於科技也改變了人們的思維和行為方式。因此有人指責,設計對世界的混亂應該負有部分責任。而這種混亂不僅僅是氣候變遷,也包括戰爭、奴隸制度、階級統治、種族主義,以及多種形式的歧視和殖民。氣候危機只是世界上各種設計行為的結果之一,無論這些設計結果是有意或無意的。

將人視為物體、視為機器的僕人

這種將人視為「服從機器要求的物體」的歷史,通常被歸因於 1700 年代英國工業革命和工廠的興起。但是在工業革命的數千年之前,埃及人、阿茲特克人(Aztecs)和中國人就利用大量工人來建造巨大的建築:墳墓、廟宇、城市,當然還有埃及金字塔和中國萬里長城。這些工人被視為可消耗、可替換的工具。數千年來,戰爭中的士兵也是如此;他們被視為國際棋局中的棋子,是在通往戰爭勝利或敗戰的道路上,根據需要可以被犧牲的戰略工具。

1900 年代初期,科學管理學者腓德烈.溫斯羅.泰勒(Frederick Winslow Taylor)研究了工人的效率,證明能夠經由改進工人的行動,盡量減少肢體或身體的多餘動作,加上簡單的裝備,來讓他們完成更多工作。他對於這項成就非常自豪,認為應該像對待機器一樣對待工人,指導他們「以最好的方式」完成每一項任務,並重新構建任務內容,以最少的步驟、最少的思考、完全不需要創造力的方式,來提高勞工的生產力。儘管這個概念將工人視為不需要思考的機器,只需要重複做同樣的工作來提高效率,工業界卻對他的生產力概念表示高度讚賞。泰勒摧毀了勞工的人性來提高生產力;他稱工人為「野蠻人」,並堅稱「不用思考」會讓他們更快樂。

1900 年代初期,工廠開始大規模生產,進一步推進了人作為機器的想法。生產線可以屠宰動物,將其加工成為一包包的肉片,生產線也可以將一堆零件裝配成一輛輛的汽車,人只是這個生產線的一部分。當然,如果我們像對待機器一樣對待人,那麼當他們反抗、感到痛苦、對工作缺乏動力或興趣時,我們就不應該感到驚訝。

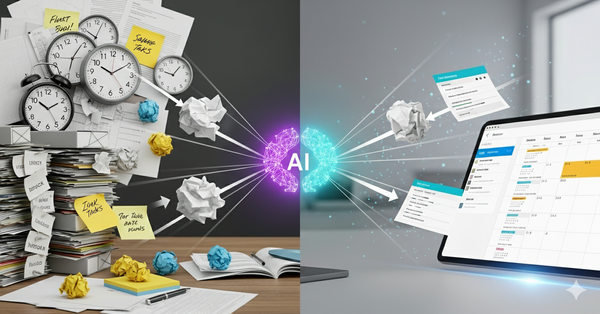

以科技為中心的勞動概念,迫使人們必須依照科技的要求工作。為什麼我們不能扭轉這種關係,讓人來主導,然後讓科技和機器依照我們的需要和要求來工作?當我們的生活受到科技要求的支配時,我們就不得不像機器一樣做事;而當我們像機器一樣做事時,我們就會表現得很糟糕。

人不是機器,即使是最聰明的機器,機器的行為方式還是與人不同。如今,負責智慧機器設計和開發的領域被稱為人工智慧(artificial intelligence,AI)。「人工」一詞用來形容顯然是人造的機器或電腦程式,也拿來形容這種「智慧」的型態。用人工的方式創造的智能,與真實的、自然的人類智慧有很大的不同,因此被稱為「人工智慧」。機器的智能在做某些方面的事情(例如解數學方程式)遠遠優於人類的智慧,但是對於許多其他事情(例如定義一個需要解決的方程式,或者任何涉及人類價值觀的事情)就差得多。我手機內建的計算機可以算得比我更快、更準確;我覺得這很有用,也不覺得這會對我有什麼威脅。我希望所有的人造工具都是如此:有用,而不是威脅。

人工智慧具有可貴的力量和可怕的弱點。人工智慧技術可以作為有價值的工具來幫助我們,但是我們必須始終記住,人工智慧是機器,而不是人;我們是人,而不是機器。我們人類彼此不同,而多元性是很有價值的。

自動駕駛領域是表達人工智慧侷限性的一個好例子。驅動這些自駕車的許多演算法都基於神經網路,這些強大的系統比大多數人類(甚至於某些專家)做得更好,但是它們的工作是模式的識別,而不是深入理解。現代人工智慧系統擅長的是模式識別的任務,例如在醫學影像(如 X 光和核磁共振成像)中發現代表腫瘤和癌症的異常徵兆,人工智慧可以比許多訓練有素的放射科醫生表現得更好。但是由於缺乏理解能力,人工智慧只能幫醫生抓出這些地方,如此而已。

當人工智慧用於駕駛汽車時,它們很難理解異常情況,例如停在高速公路中間的緊急車輛。無法理解情況,也意味人工智慧可能會忽視這些情況,因此自駕車已經導致了許多事故和死亡。另一方面,有些人工智慧系統會過於謹慎,如果無法確定是否有車輛、行人或自行車即將過馬路,自駕車會猶豫是否要通過十字路口。當自駕車後面的車輛沒有預期到前車這種緩慢、猶豫的行動時,會因此撞上前車。人工智慧的過於謹慎,同樣會造成事故。

自駕車的製造公司用法律來為自己辯護:公司已經警告過駕駛人必須始終保持警惕,準備好在自動化系統出問題時隨時接手。這種辯護策略可能在法庭上有效,但是它卻違背了研究者(包括我在內)數十年來在人為因素和心理學領域的研究。如果人對一個系統已經進行了數小時,甚至數天的仔細監控,卻沒有出現任何問題,那麼對這個系統的監控就無法繼續下去。在一段時間內沒有發生任何事情時,人就無法將注意力繼續集中在意外事件的可能性上。

本文節錄自《設計,讓世界變更好》,由遠流授權轉載。